图片一键还原立体世界!如视空间大模型Argus发布

随手拍的照片秒变3D

苹果iOS26的3D壁纸效果是如何实现的?

你随手拍下的2D照片如何能够“活起来”,转化为可量化、可交互的三维空间?

这背后,正是空间智能技术不断演进的结果。作为数字空间及空间智能综合解决方案的引领者,如视始终坚持技术创新与突破,今天又带来一大全新技术突破——空间大模型Argus。

Argus是目前已知首个支持全景输入的空间深度推测大模型,能够以毫秒级的速度从一个场景下的单张或多张全景图像中推理出所有图像的绝对尺度的相机位姿、深度、点图等核心三维属性,从而实现从2D图像到3D空间的重建。

也就是说,你随手拍的几张照片,在Argus的处理下,可以瞬间还原出一个立体的3D世界。

三大突破特性

Argus基于Transformer架构构建,是一个前馈式神经网络模型。如视算法团队依托如视积累的千万级真实空间数据集对模型进行系统训练,使其在兼容性、实时性与生成质量三大维度实现行业突破。

No.1 兼容性

Argus是业界首个且唯一支持全景图作为输入的深度推测大模型。同时,它也支持输入单张/多张全景照片、针孔照片、AI图片等,具备多源适应能力。

No.2 实时性

Argus通过网络架构的设计,构建了实时全景图全局重建系统,推理效率达毫秒级。从上传图像到生成 3D 结果,全流程无感知响应。这不仅改变了三维重建的交互流程,长远来看,更为实时动态三维重建等未来应用打开了广阔空间,让动态空间的瞬时数字化成为可能。

No.3 极优生成

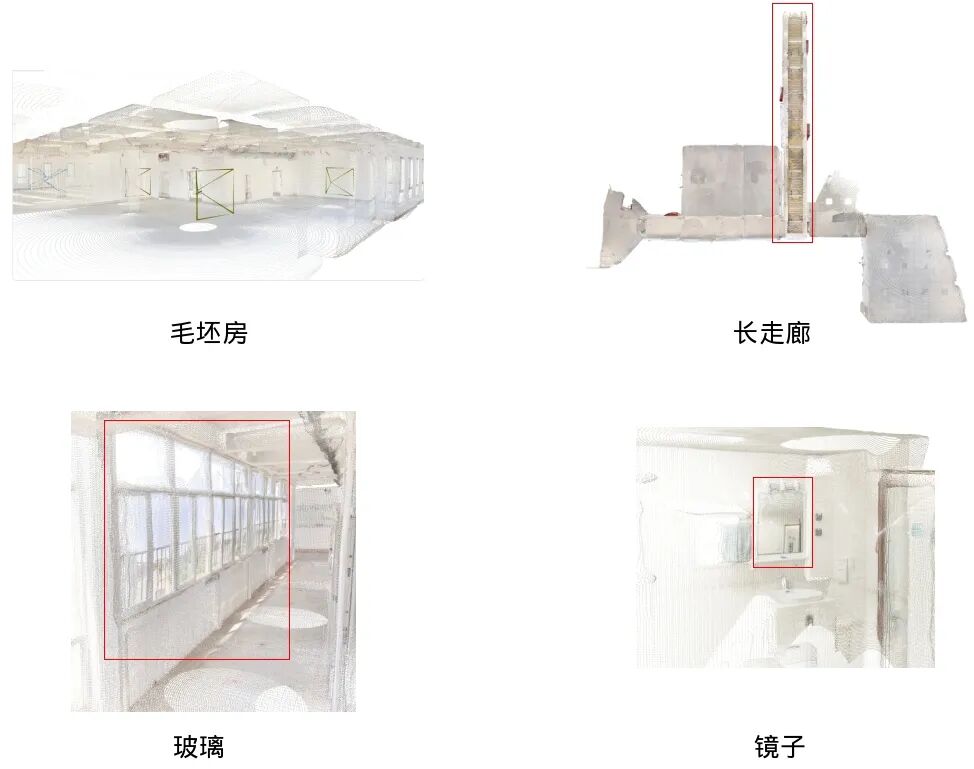

如视凭借硬件与算法深度融合的技术路径,构建了全球最大的实景三维空间数据库,涵盖超过5300万高质量、完备且高一致性的空间数据。Argus充分挖掘这一数据优势,在网络架构上适配了如视数据特性,产物效果更优;即便面对玻璃、镜面、毛坯房、长走廊等三维重建传统难点场景,Argus仍表现稳定,显著优于当前业界缺乏真尺度或对齐能力的方案。

应用场景

Argus打通了从2D到3D、从单视角到多视角的关键技术屏障,使各类平面图像应用得以延伸至三维物理空间,赋能诸如动态3D壁纸、实时监控、新视点合成等多元场景。

以生成点云与深度为起点,依托如视完整的三维重建与空间智能应用体系,Argus未来可进一步用于实时渲染的3DGS模型和精细Mesh模型,为空间漫游提供沉浸式数字基底。通过与如视自研的空间智能算法结合,它还能驱动空间CAD自动生成、高精度语义分割及白模构建等高阶应用,实现从物理世界到数字空间,再赋能现实应用的闭环。

开放数据集

空间生成是空间智能广阔图景的一部分。Argus 的实践充分证明,如视积累的海量真实高质量空间数据,可以成为驱动空间智能应用技术的基石。为加速领域研究演进,如视计划于今年年底开放 10000 套空间数据集,赋能行业专业人士深耕前沿技术,助力空间智能更深入的发展。

Argus限时免费开放,欢迎体验:

https://h5.realsee.cn/argus